- DAZ.online

- DAZ / AZ

- DAZ 11/2019

- Achtung Fallstricke

Statistik

Achtung Fallstricke

Ein Meinungsbeitrag zum Umgang mit Risiko in der Medizin und der Hoffnung auf Einsicht

Schon bei herkömmlichen Therapien erweist sich ein informierter Umgang mit Risiko oftmals als schwierig, wie das folgende Beispiel illustriert. In Großbritannien meldete die britische Aufsichtsbehörde für Arzneimittelsicherheit im Jahre 1995, dass bestimmte orale Empfängnisverhütungsmittel das Thromboserisiko verdoppeln, also um 100% erhöhen würde. Die Nachricht wurde von den Medien aufgegriffen und z. B. vom „Sunday Times Magazine“ auf der Titelseite plakativ in Szene gesetzt mit rotgeschminkten vollen Lippen und der Antibabypille im Mund, Überschrift: Der Kuss des Todes – ist die Pille verdammt? Viele Frauen reagierten mit Panik und Verunsicherung – und setzten die Pille ab.

Die Folgen zeigten sich im Jahr darauf, in dem es etwa 12.400 zusätzliche Geburten und 13.600 zusätzliche Abtreibungen gab, was Kosten von geschätzt 25 Millionen Pfund mit sich brachte. Zudem bergen sowohl Schwangerschaften als auch Abtreibungen eine Erhöhung des Thromboserisikos, das das der Pille bei weitem übersteigt. Was war mit der Risikoerhöhung um 100% gemeint? Eine Studie hatte ergeben, dass das absolute Thromboserisiko von einem auf zwei Fälle je 7000 Frauen anstieg. Die relative Erhöhung des Risikos um 100% war also nicht falsch – wohl aber hochgradig irreführend für die Leserinnen und Leser, wenngleich der Zeitungsauflage wahrscheinlich zuträglich. Wenn stattdessen die absolute Risikoerhöhung von 1 in 7000 kommuniziert worden wäre, wäre die Pillenpanik vermutlich ausgeblieben.

Wie sag ich’s meinem Patienten?

Solche Missverständnisse von statistischen Informationen, die Risiken quantitiv ausdrücken, sind kein neues Phänomen. Bereits im Jahr 1937 bemerkte ein Leitartikel in „The Lancet“ über die medizinische Ausbildung, dass der Gebrauch (oder Missbrauch) von Statistiken „tendenziell eine starke emotionale Reaktion bei nicht mathematischen Gemütern hervorruft“. Es wurde geklagt, dass „für die meisten von uns Zahlen auf einen blinden Punkt treffen“, was „schade ist, weil einfache statistische Methoden uns viel stärker betreffen als viele der Dinge, die wir gezwungen sind, in den sechs langen Jahren des medizinischen Studienplans zu lernen“.

Und auch wenn sich sowohl die medizinische Ausbildung als auch die Informationsgrundlage durch klinische Studien seitdem deutlich verbessert haben, verhindert ein mangelhaftes Verständnis von statistischer Evidenz auch heute noch oft informierte medizinische Entscheidungen. Doch sollte man deshalb, wie teils hinter vorgehaltener Hand gefordert wird, Patienten lieber von Entscheidungen fernhalten? Dahinter zeigt sich auch die größere gesellschaftliche Frage, inwieweit den Bürgern in einer demokratischen Gesellschaft zu trauen ist, gute Entscheidungen für sich selbst zu treffen. Eine bevormundende Sichtweise halte ich hierbei nicht nur aus ethischer Sicht für problematisch. Es spricht auch dagegen, dass (i) Patienten oftmals andere Präferenzen als ihre Ärzte haben, dass (ii) auch Experten irren können, und dass (iii) statistische Information leicht verständlich gemacht werden kann.

Patienten können andere Präferenzen haben als ihre Ärzte

In der Medizin gibt es meistens nicht die eine richtige Entscheidung, sondern diese hängen auch von individuellen Präferenzen ab. Was Menschen für sich als richtig erachten, kann sehr verschieden sein, und hierbei sind systematische Unterschiede zwischen Ärzten und Patienten gut dokumentiert. Obwohl Ärztinnen und Ärzte natürlich über mehr medizinisches Wissen verfügen, können sie ihren Patienten daher die Entscheidungen leider nicht abnehmen.

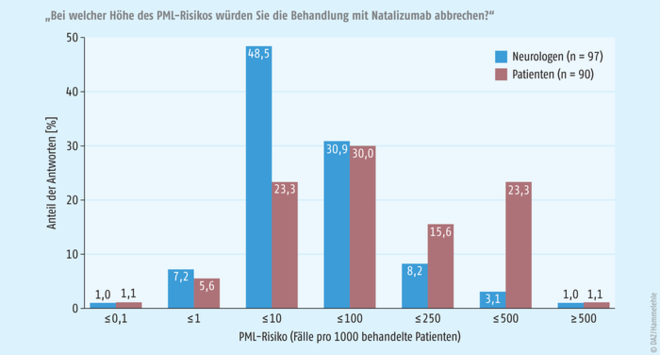

So scheuen Ärzte bei medizinischen Entscheidungen für ihre Patienten Risiken stärker als für sich selbst, und sie scheuen diese auch stärker als die Patienten. Ein Beispiel aus der neurologischen Praxis: Eines der wirksamsten Medikamente zur Behandlung von multipler Sklerose ist Natalizumab (Tsyabri®).

Seit einigen Jahren ist jedoch bekannt, dass Natalizumab das Risiko einer progressiven multifokalen Leukenzephalopathie (PML) als schwerwiegender Nebenwirkung birgt, die Behinderungen oder sogar den Tod nach sich ziehen kann. Für die Abwägung von Nutzen und Risiko ist es daher relevant, bei welcher Wahrscheinlichkeit einer PML Ärzte und Patienten die Behandlung mit Natalizumab jeweils abbrechen würden. In größeren Befragungen fanden wir, dass Patienten bereit waren, für den Nutzen des Medikaments viel höhere Risiken in Kauf zu nehmen als ihre Ärzte. Risiken einer PML, die bei über 1% liegen, wurden beispielsweise nur von 43,3% der Ärzte, aber von 68,9% der Patienten akzeptiert (Abbildung 1).

Nun ist es nicht unvernünftig, bei Entscheidungen für andere Risiken stärker zu vermeiden, als bei Entscheidungen für sich selbst. Doch gerade weil bei medizinischen Therapien ein größerer Nutzen tendentiell mit häufigeren oder schwerwiegenderen Nebenwirkungen einhergeht, kann es aus Patientensicht durchaus sinnvoll sein, ein gewisses Maß an Risiko einzugehen.

Letztlich bleibt stets die Abwägung von Nutzen und Schaden verschiedener Therapien, und auch die Option, gänzlich auf eine Therapie zu verzichten, kann eine erwägenswerte sein. In diese Abwägungen müssen Patienten mit einbezogen werden, um entsprechend ihrer Präferenzen, Wünsche und konkreten Lebenssituation die für sie passende Behandlung zu finden. Diese Bürde können Ärzte ihren Patienten nicht abnehmen. Sie können sie aber bestmöglich begleiten, indem sie sie verständlich informieren. Und hierbei kommen wir zu der nächsten Schwierigkeit.

Auch Experten können irren oder irregeleitete Empfehlungen abgeben

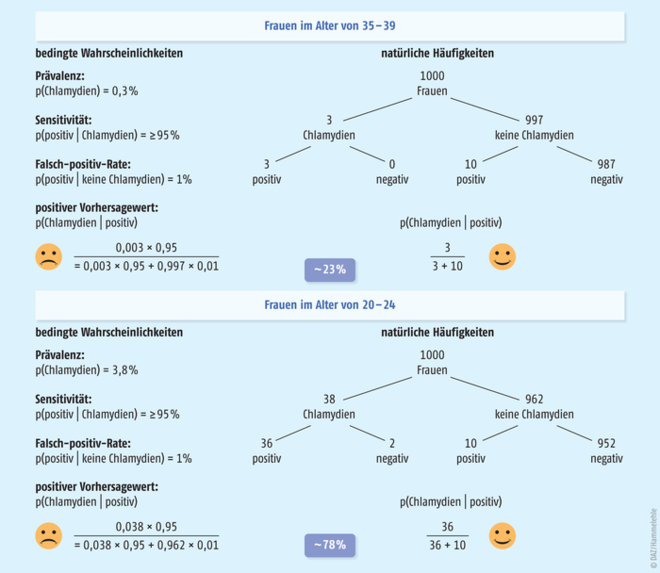

Zur Interpretation von Testergebnissen werden häufig bedingte Wahrscheinlichkeiten kommuniziert. Stellen Sie sich vor, eine 36-jährige Frau wird im Rahmen eines Screenings mit dem Nukleinsäure-Amplifikationstest (NAAT) auf Chlamydien getestet. Angenommen, das Testergebnis ist positiv (auffällig), wie hoch ist dann die Wahrscheinlichkeit, dass die Frau tatsächlich Chlamydien hat? Um diesen positiven Vorhersagewert zu berechnen, braucht man drei statistische Informationen:

1. Die Wahrscheinlichkeit, dass eine Frau im Alter von 35 bis 39 Chlamydien hat, beträgt 0,3% (Prävalenz).

2. Wenn eine Frau Chlamydien hat, beträgt die Wahrscheinlichkeit, dass der Test positiv anschlägt mindestens 95% (Sensitivität).

3. Wenn eine Frau keine Chlamydien hat, beträgt die Wahrscheinlichkeit, dass der Test dennoch (falsch) positiv anschlägt 1% (Falsch-positiv-Rate).

Anhand des Theorems von Bayes lässt sich mithilfe dieser Informationen nun der positive Vorhersagewert ausrechnen:

p(Chlamydien|positiv) = .003 × .95 / [.003 × .95 + .997 × .01] ≈ 23%

Die Wahrscheinlichkeit, dass eine 36-jährige Frau tatsächlich Chlamydien hat, gegeben dass der Test positiv anschlägt, beträgt also nur ca. 23%. Nur die allerwenigsten Ärzte und noch weniger Patienten können dies jedoch richtig ausrechnen. Viele Menschen verwechseln hierbei den positiven Vorhersagewert, also p(Chlamydien|positiv), mit der Sensitivität des Tests, also p(positiv|Chlamydien), und würden in diesem Beispiel dann fälschlicherweise annehmen, dass der positive Vorhersagewert 95% statt 23% wäre – eine massive Überschätzung (siehe auch Abbildung 2).

Natürlich sind diese inversen Wahrscheinlichkeiten nicht identisch, wie sich an einem intuitiveren Beispiel veranschaulichen lässt: Bis jetzt waren in Deutschland alle Bundespräsidenten männlich, p(männlich|Bundespräsident) = 100%. Ohne Männern zu nahe treten zu wollen ist die umgekehrte Wahrscheinlichkeit, p(Bundespräsident|männlich), natürlich verschwindend gering.

Doch kommt es nicht nur zu irregeleiteten Empfehlungen aufgrund statistischer Missverständnisse. Teilweise stellen sich selbst etablierte Institutionen gegen wissenschaftliche Erkenntnisse, die ihnen nicht gefallen. Ein besonders heißes Eisen im Gesundheitswesen sind hierbei alternativmedizinische Verfahren. Auch wenn das nicht heißen soll, dass es keinerlei wirksame Alternativmedizin gäbe, so halten deren Versprechungen doch oftmals einer evidenzbasierten Betrachtung nicht stand. Die Homöopathie gelangt immer wieder ins Blickfeld der Kritik, da große Überblicksarbeiten wiederholt zeigten, dass sie nicht über das Placebo-Niveau hinaus wirksam ist. Eine solche Wirksamkeit über Placebo hinaus wird jedoch bei „klassischen“ Therapieverfahren gefordert, und es gibt keinen Grund, bei alternativmedizinischen Verfahren hier einen anderen Standard anzulegen. Trotz gegenteiliger Evidenz erfreuen sich Therapien ohne Wirksamkeitsnachweis wie die Homöopathie weiterhin großer Beliebtheit, und das spiegelt sich auch als Geschäftsmodell in den Regalen einiger Apotheken wider, die teilweise gut gefüllt mit teuren Placebos sind. Eine Abteilung der Österreichischen Ärztekammer ließ sich von einer kritischen Meta-Analyse im Jahr 2005 sogar dazu hinreißen, Meta-Analysen als Instrument der theoretischen Wissenschaft ohne Relevanz für die ärztliche Praxis abzukanzeln, und auch in der deutschen Politik ist Unterstützung für Homöopathie und andere nutzlose Therapien keinesfalls selten, bis hinein in hohe Ämter. Ein fatales Signal, gibt es doch kaum bessere Evidenz als Meta-Analysen von randomisierten kontrollierten Studien. Ein fatales Signal außerdem, da es zeigt, dass Bürgerinnen und Bürger sich bei der Bewertung von Wissenschaft und darauf fußenden Empfehlungen keineswegs immer auf die Politik und medizinische Instanzen verlassen können. Ein weiterer Grund daher, Entscheidungen selbst in die Hand zu nehmen und informiert zu treffen. Und die gute Nachricht ist, dass Einsicht in wissenschaftlich-statistische Informationen tatsächlich möglich ist.

Einsicht: statistische Informationen, leicht verständlich

Die bisherigen Beispiele haben bereits angedeutet, dass Statistiken oftmals deshalb so schwer zu verstehen sind, weil sie irreführend dargestellt werden. So zeigte das Beispiel der Pillenpanik, dass eine relative Risikoerhöhung um 100% dasselbe sein kann wie eine absolute Steigerung des Risikos von 1 in 7000 auf 2 in 7000. Das Problem mit relativen Risiken ist, dass sie keinerlei Informationen über die Basisrate des Risikos beinhalten, also darüber, wie hoch das Risiko grundsätzlich ist. Die relative Risikoerhöhung ist identisch, unabhängig davon, ob sich das absolute Risiko von 1 auf 2 in jeweils 7000 oder von 1000 auf 2000 in jeweils 7000 erhöht, obwohl letztere Erhöhung viel größere Auswirkungen hätte. Relative Risiken führen jedoch nicht nur dazu, dass Gefahren unter Umständen maßlos überschätzt werden, sie können auch dazu führen, dass der Nutzen von Therapien überschätzt wird. So wurde in den USA beispielsweise für das Medikament Lipitor® damit geworben, dass es für bestimmte Patientengruppen das (relative) Risiko eines Schlaganfalls um knapp die Hälfte (48%) reduzieren würde. In absolute Risiken übersetzt bedeutete dies, dass statt 28 je 1000 Patienten nur 15 je 1000 einen Schlaganfall erlitten, das Risiko sank also um 13 Personen je 1000 oder 1,3 Prozentpunkte. Auch dies natürlich ein beachtlicher Effekt, doch zeigt eine Vielzahl von Studien, dass selbst erfahrene Ärztinnen und Ärzte den Nutzen von Medikamenten überschätzen, wenn dieser relativ statt absolut kommuniziert wird.

Die unterschiedlichen Auswirkungen verschiedener Darstellungen von Statistiken bieten aber gleichzeitig den Schlüssel zur verständlichen Risikokommunikation. Nobelpreisträger Herbert Simon hat einmal festgestellt, dass die Lösung eines Problems schlicht darin besteht, es so darzustellen, dass die Lösung sichtbar wird. In diesem Sinne können Statistiken durch transparente Darstellungen verständlich gemacht werden, so wie absolute Risiken leicht verständlich, relative Risiken aber irreführend sind.

Dieses Prinzip unterschiedlicher Darstellungen lässt sich auch auf komplexere statistische Sachverhalte anwenden. Denken Sie an das Beispiel der 36-jährigen Frau zurück, die im Rahmen eines Screenings mit dem Nukleinsäure-Amplifikationstest (NAAT) auf Chlamydien getestet wurde. Anstatt die relevanten Informationen in Form bedingter Wahrscheinlichkeiten darzustellen, wird die Lösung sichtbar, wenn man sie als natürliche Häufigkeiten darstellt. Stellen Sie sich dazu 1000 Frauen vor, die 36 Jahre alt sind.

1. Von 1000 Frauen im Alter von 35 bis 39 haben drei Chlamydien (Prävalenz).

2. Von diesen drei Frauen mit Chlamydien werden nahezu alle entdeckt (Sensitivität ≥ 95%), runden wir der Einfachheit auf alle drei.

3. Von den übrigen 997 Frauen ohne Chlamydien werden dennoch ca. zehn falsch-positiv getestet (Falsch-positiv-Rate 1%).

Demnach werden von jeweils 1000 Frauen insgesamt 13 positiv getestet, jedoch sind nur 3 von diesen tatsächlich an Chlamydien erkrankt. Der positive Vorhersagewert lässt sich dann leicht ausrechnen als 3/13 ≈ 23%. Abbildung 2 stellt die beiden Darstellungsformen der bedingten Wahrscheinlichkeiten und der natürlichen Häufigkeiten noch einmal anschaulich gegenüber.

Mit natürlichen Häufigkeiten lässt sich nun auch noch ein weiteres für viele erst einmal nicht intuitives Phänomen illustrieren: Dasselbe Testergebnis eines diagnostischen Verfahrens bedeutet für unterschiedliche Menschen nicht dasselbe. Nehmen wir wiederum eine Frau, die bei einem Screening mit dem Nukleinsäure-Amplifikationstest (NAAT) auf Chlamydien getestet wurde, doch nehmen wir diesmal an, dass es sich nicht um eine 36-jährige, sondern um eine 22-jährige Frau handelt. Die Test-Charakteristika sind die gleichen: Die Sensitivität des Tests liegt weiterhin bei ≥ 95%, die Falsch-positiv-Rate bei 1%. Doch die Prävalenz ist in dieser Altersgruppe höher: Statt bei 0,3% (wie bei Frauen zwischen 35 und 39) liegt sie bei Frauen im Alter von 20 bis 24 bei 3,8%. Stellen wir uns nun 1000 Frauen im Alter von 22 Jahren vor.

1. Von 1000 Frauen im Alter von 20 bis 24 Jahren haben 38 Chlamydien (Prävalenz = 3,8%).

2. Von diesen 38 Frauen mit Chlamydien werden 36 positiv getestet (Sensitivität ≥ 95%)

3. Von den übrigen 962 Frauen ohne Chlamydien werden dennoch ca. zehn falsch positiv getestet (Falsch-positiv-Rate = 1%).

Demnach werden von jeweils 1000 Frauen im Alter von 20 bis 24 Jahren nun 46 positiv getestet, und 36 von diesen 46 Frauen sind richtig positiv. Somit liegt der positive Vorhersagewert für die Gruppe der 20- bis 24-Jährigen bei 36/46 ≈ 78% und damit wesentlich höher als in der Gruppe der 35- bis 39-Jährigen (23%) (Abbildung 2 unten).

Fazit

Diese Beispiele zeigen, dass der Umgang mit Risiko in der Medizin oftmals schwierig und von vielen Missverständnissen geprägt ist. Sie zeigen aber auch, dass ein informierter Umgang mit Risiko und eine Einbeziehung von Patienten nötig und möglich sind. Nötig, weil Patienten, wie alle Menschen, eigene Präferenzen und Vorstellungen haben und sie somit Entscheidungen nicht delegieren können, und weil auch Experten Fehleinschätzungen und Missverständnissen zum Opfer fallen. Möglich, weil sich durch relativ einfache Änderungen der Darstellung von statistischer Information diese transparent und verständlich machen lässt. Bereits in den 1930er-Jahren hatte der Science-Fiction-Autor H. G. Wells die Vision, dass ein aufgeklärtes Bürgertum in einer modernen Demokratie drei Fähigkeiten braucht: Lesen, Schreiben und statistisches Denken. Zu Beginn des 21. Jahrhunderts haben die meisten Menschen in diesem Land Lesen und Schreiben gelernt, nicht aber statistisches Denken. Wir können dies durch transparente Risikokommunikation fördern und sollten diese Fähigkeit am besten bereits im Kindesalter vermitteln. So wären Menschen nicht mehr Spielball unangemessener Ängste und Hoffnungen, und auch über die Medizin hinaus würde es ein Klima der Teilhabe, Aufklärung und Selbstbestimmung fördern. |

Festvortrag auf der Interpharm

Gefühl schlägt Evidenz – Fallstricke beim Umgang mit Risiko in der Medizin

„In dieser Welt ist nichts gewiss, außer dem Tod und den Steuern“, schrieb der US-Staatsmann Benjamin Franklin bereits 1789, am Vorabend der Französischen Revolution. Das gilt – mit Sicherheit – auch heute noch. Alles andere im Leben bleibt jedoch ungewiss. Viele Menschen gehen nicht gerne mit Ungewissheit um. Die meisten streben ängstlich nach Gewissheiten, die es nicht gibt.

Diese Sehnsucht ist Teil unseres emotionalen und kulturellen Erbes: Menschen suchen Trost in Religion, Astrologie und Weissagung. Doch der Eindruck der Berechenbarkeit ist natürlich eine Illusion. Umso mehr lassen wir uns dann verunsichern, wenn sich etwas einmal als unberechenbar erweist. Diese Unsicherheit im Umgang mit der Ungewissheit ist in der heutigen technologischen Gesellschaft zu einem Problem geworden. Wir brauchen daher eine Gesellschaft, in der Bürgerinnen und Bürger informiert mit Risiken umgehen und leben.

Gerade in der Medizin erfordern informierte Entscheidungen, dass sowohl die Ärzteschaft als auch Patientinnen und Patienten Nutzen und Schaden medizinischer Eingriffe richtig einschätzen können. Doch ein informierter Umgang mit Risiko bleibt für viele eine Herausforderung. Anhand von Beispielen aus dem Bereich Gesundheit werde ich illustrieren,

- dass ein mangelhafter Umgang mit Risiko und Wahrscheinlichkeiten ein kollektives Problem ist und keinesfalls nur Laien betrifft,

- dass ein Mangel an Evidenzkultur in der Gesellschaft dazu beiträgt, wie eine grundlegende Fehlwahrnehmung von Zufälligkeit vielerlei medizinischen und anderen Aberglauben befördert und

- wie soziale Prozesse die Risikowahrnehmung formen und verstärken können.

Aber es gibt Hoffnung: Zum Abschluss werde ich darlegen, wie sich diese Hindernisse durch das Unterrichten von statistischem Denken und durch transparente Risikokommunikation überwinden lassen, um ein Klima der Teilhabe, Aufklärung und Selbstbestimmung zu schaffen.

Festvortrag

Prof. Dr. Wolfgang Gaissmaier, Universität Konstanz

Freitag, 15. März 2019, 17.10 Uhr,

im Rahmen der Interpharm in Stuttgart.

Weitere Informationen finden Sie unter www.interpharm.de

0 Kommentare

Das Kommentieren ist aktuell nicht möglich.